Pier Luigi Pisa Repubblica del 14 LUGLIO 2023

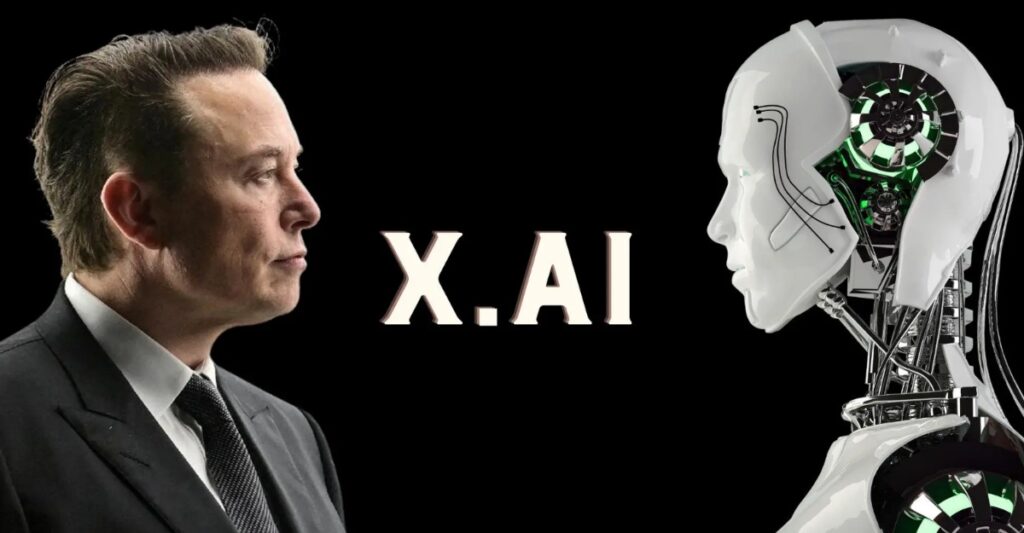

A Elon Musk non bastavano Tesla, Space X e Twitter. L’imprenditore, infatti, ha fondato una nuova azienda. Si chiama xAI e ha l’obiettivo di “comprendere la natura dell’universo” attraverso lo sviluppo dell’intelligenza artificiale. Sul sito della nuova creatura si legge che xAI «lavorerà attivamente con Twitter, Tesla e altre compagnie per raggiungere la sua missione». Il team di xAI è guidato proprio da Musk e include undici persone – tutti uomini – che hanno lavorato in passato in grandi compagnie che sviluppano AI: OpenAI, Google Research, Microsoft Research, and DeepMind.

Il supervisore di xAI è Dan Hendrycks, che attualmente ricopre il ruolo di direttore del Centre for AI Safety. Quest’ultima è un’associazione non profit di San Francisco che ha pubblicato, recentemente, una breve lettera apocalittica in cui si paragonano i rischi derivanti dall’AI a quelli legati ad armi nucleari e pandemie. E si ipotizza l’estinzione dell’umanità se l’intelligenza artificiale non sarà opportunamente regolamentata.

L’azienda con cui Musk lancia la sua sfida a OpenAI, di cui tra l’altro risulta tra i fondatori, arriva in un momento particolarmente delicato per ChatGpt. I suoi utenti, per la prima volta da quando è stata lanciata l’intelligenza artificiale generativa di OpenAI, sono in calo. A giugno scorso – stando ai dati Similarweb – il traffico da mobile e da computer è diminuito del 9,7%. Eppure i suoi server sembrano sempre più affollati. Anche gli abbonati, che in teoria dovrebbero avere una corsia preferenziale, negli ultimi giorni hanno fatto fatica ad accedere. Non l’hanno presa bene. Per la versione “Plus” pagano 20 dollari al mese. In Italia, con le tasse, diventano 24. Può essere un buon motivo per andarsene.

Le alternative ormai sono numerose. Molte di queste gratuite. C’è Bing di Microsoft, che tra l’altro usa proprio l’AI di ChatGpt per generare le sue risposte. E c’è Bard di Google, finalmente disponibile anche in Italia. Ma la soluzione più interessante è Claude, il modello di intelligenza artificiale generativa sviluppato da due fratelli italoamericani: Dario e Daniela Amodei. Insieme hanno fondato Anthropic, un’azienda che sviluppa AI senza cercare unicamente il profitto, come fa ChatGpt. La loro è una Public Benefit Corporation, impresa che oltre agli utili insegue – come definisce il suo statuto – anche benefici per la società. Dario e Daniela vogliono fare molto di più. Intendono proteggerla. Dai potenziali rischi legati alla crescita incontrollata dell’intelligenza artificiale. I fratelli Amodei non hanno firmato appelli inconcludenti per “fermarla”, come ha fatto Elon Musk. Piuttosto, hanno lavorato a una soluzione.

Claude risponde a una raccolta di regole che Anthropic ha chiamato la “Costituzione dell’AI”. «Stiamo sperimentando metodi per addestrare una AI innocua che non richieda l’intervento dell’uomo», si legge sul sito di Anthropic. L’obiettivo è fare in modo che Claude sorvegli da sola le risposte che genera. Basandosi unicamente sull’elenco di princìpi fornito dai suoi ideatori. Proprio come i robot dei racconti di Asimov rispondevano alle tre leggi della robotica. L’intento è identico: non arrecare danni agli esseri umani. «Preferiamo che la nostra AI fornisca le sue risposte sulla base di valori determinati da una Costituzione – dice Anthropic – e non su quelli che scaturiscono dai feedback degli utenti su larga scala». E dunque Claude – per ora disponibile negli Usa e nel Regno Unito, ma presto anche in Italia – si basa su regole precise e soprattutto trasparenti, pubblicate sul sito di Anthropic e che si ispirano, tra le altre cose, ai princìpi provenienti dalla Dichiarazione universale dei diritti umani e a quelli dei “termini di servizio” di Apple. Uno di questi rispecchia, in effetti, l’attenzione alla privacy dell’azienda di Cupertino: «Scegli la risposta che contiene meno informazioni personali, private o riservate appartenenti ad altri».

Tutto questo non rende l’AI di Anthropic necessariamente “migliore” di ChatGpt. Claude, come la creatura di OpenAI, pare soffrire di allucinazioni. Un giornalista del Guardian le ha chiesto chi avesse vinto l’ultima Conference League e l’AI ha risposto «As Roma», che aveva vinto l’anno scorso, invece di «West Ham» (vincitore quest’anno). Abbiamo fatto la stessa prova e Claude ci ha detto che «la finale di Conference non è stata ancora giocata», mostrando limiti temporali alla sua conoscenza. L’AI di Anthropic ha lo stesso problema di ChatGpt, insomma, per cui è come se il mondo si fosse fermato a qualche tempo fa.

Eppure Claude, giunta in questi giorni alla sua seconda versione, e aperta finalmente al pubblico dopo un periodo di test riservato alle aziende, offre qualcosa di inedito nel panorama delle AI generative: può gestire testi molto lunghi, contenenti fino a 75mila parole. ChatGpt, invece, può analizzare fino a un massimo 3.000 parole. Ma per Dario e Daniela Amodei, che hanno lavorato in OpenAI per cinque anni prima di fondarne una che oggi vale 4,1 miliardi di dollari, la differenza principale è un’altra: «Claude tenda a dare risposte meno nocive. È più gentile, sembra davvero di parlare con un umano».

Pier Luigi Pisa Repubblica del 14 LUGLIO 2023